はじめに

iPhoneXの表情検出機能を使ったサンプルである「Face AR Sample」が先日公開されました!検出した表情の情報をカイトくんや「AppleARKitFaceMeshコンポーネントにより生成された3Dモデル」に反映することができます。試しに動作している様子を動画に撮ってみました。

www.youtube.com

これだけだとよくあるコンテンツなのですが…Face AR Sampleにはなんと

PC上のエディタとの同期機能

が用意されています!!!

つまり、iPhoneXで検出した表情の情報をPCに送ることができます。

え、ちょっと待って!?Face AR Sample、ライブリンク機能でエディタとフェイシャル情報を同期できるやん!つまり、モーションとフェイシャルのキャプチャをするシステムをエンジンの標準機能だけで組めるやん!凄いやん! #UE4 #UE4Study pic.twitter.com/CiKTvW7crc

— おかず (@pafuhana1213) 2018年7月26日

そして、エディタを実行しなくても同期処理は行われます!

お、アニメーションエディタ(Persona)上でも同期するやん!デバッグだけでなく、エディタ上でアニメーション録画もできるからフェイシャルアニメーション作り放題やん! #UE4 #UE4Study pic.twitter.com/0exX0gFTIW

— おかず (@pafuhana1213) 2018年7月26日

つまり…Personaのアニメーション録画機能を使えば、

UE4の標準機能とIPhoneXだけで、

フェイシャルアニメーションを作成することができます!

さくっと、フェイシャルアニメーション作成完了!ね、簡単でしょ? #UE4 #UE4Study pic.twitter.com/Dpomhyiv3F

— おかず (@pafuhana1213) 2018年7月26日

うおおおおおおお!!!!!!!!

ということで、手順を簡単に解説します。

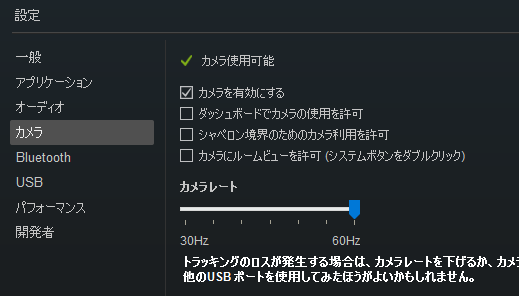

なお、当然ながらiPhoneXは必要なのですが、更にビルド用にMacが必須になります。また、PC - iPhoneX間で通信を行う必要があるため、それぞれを同じネットワーク環境下に置く必要があります。